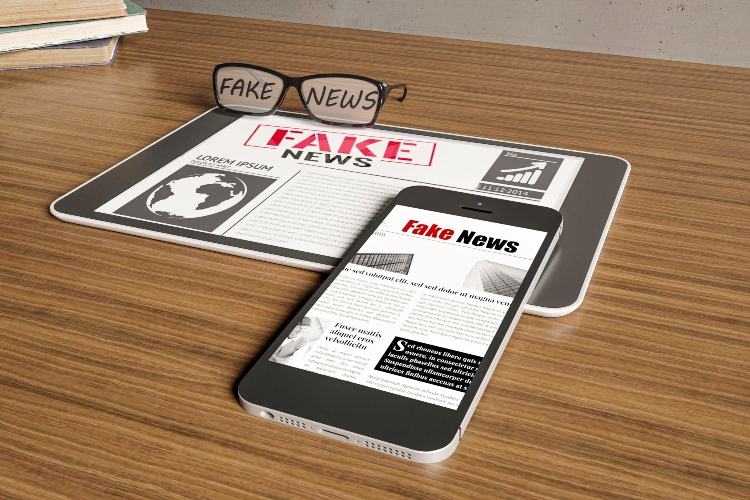

La tecnología de Deepfakes en la escuela ha encendido las alarmas en instituciones educativas de varios países. Las autoridades investigan casos en los que estudiantes y profesores fueron víctimas de imágenes y videos manipulados con inteligencia artificial y utilizados para difamar, acosar o intimidar.

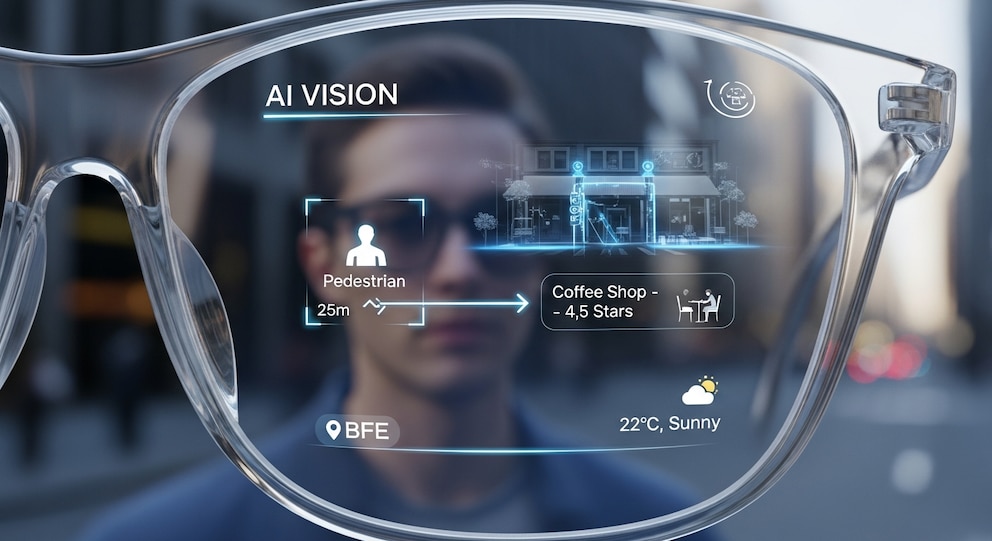

Los deepfakes son contenidos audiovisuales generados o modificados mediante algoritmos de inteligencia artificial, capaces de imitar rostros, voces y gestos con un alto grado de realismo. Aunque esta tecnología tiene aplicaciones legítimas en cine y publicidad, su uso indebido en las escuelas plantea una amenaza creciente.

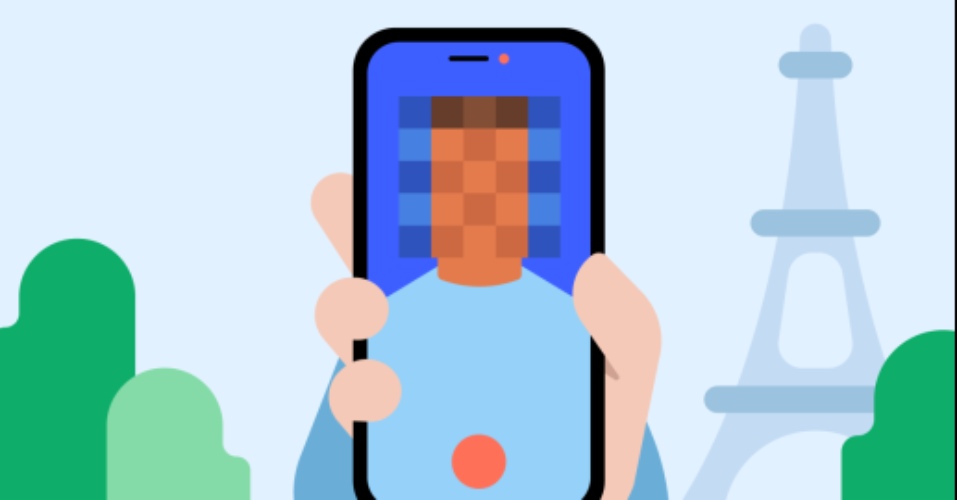

En varias instituciones educativas, los estudiantes han creado falsos montajes que implican a los docentes en situaciones inexistentes o han manipulado imágenes de compañeros con fines de burla o chantaje digital. Esta práctica no sólo viola la privacidad sino que también puede tener graves consecuencias emocionales y legales.

Una nueva forma de acoso digital

El auge de las herramientas de inteligencia artificial accesibles ha facilitado la creación de deepfakes sin necesidad de conocimientos técnicos avanzados. Las plataformas basadas en modelos de generación de imágenes y vídeos, como las desarrolladas por empresas como OpenAI, han impulsado importantes avances tecnológicos. Pero los expertos advierten que herramientas similares, si se utilizan sin supervisión, pueden convertirse en herramientas de acoso.

En el entorno escolar, los efectos son especialmente sensibles. Las víctimas pueden sufrir ansiedad, aislamiento social, daños a su reputación y, en el caso de los docentes, incluso sus carreras profesionales. Además, la rápida viralización en las redes sociales amplifica los daños en unas pocas horas.

Psicólogos y especialistas en ciberseguridad coinciden en que este fenómeno representa una evolución del ciberbullying tradicional, ahora potenciado por la inteligencia artificial.

Respuesta de las autoridades educativas

Ante esta tendencia, los ministerios de educación y las autoridades judiciales de varios países han iniciado investigaciones y campañas de sensibilización. Algunas instituciones han actualizado sus manuales de convivencia para incluir sanciones específicas relacionadas con la creación y distribución de contenidos manipulados por IA.

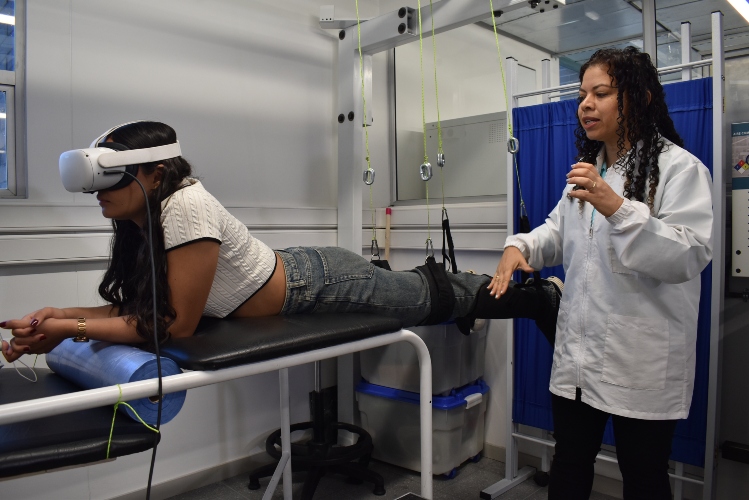

Además, se promueve la competencia digital como herramienta preventiva. Enseñar a los estudiantes a reconocer contenido falso, comprender las implicaciones legales y éticas del uso de la IA y promover el respeto en entornos digitales son estrategias importantes para mitigar el problema.

En determinados casos, la creación y distribución de deepfakes con fines de acoso puede constituir delitos como la suplantación de identidad, la difamación o el acoso digital, que también pueden tener consecuencias legales para los menores.

El desafío tecnológico y ético

El debate no es sólo sobre la disciplina escolar, sino también sobre la regulación técnica. Los gobiernos y las organizaciones internacionales están discutiendo marcos regulatorios que requieran que los desarrolladores y las plataformas digitales asuman una mayor responsabilidad para evitar el uso indebido de estas herramientas.

Mientras tanto, los expertos recomiendan que padres y maestros se mantengan actualizados sobre lo que usan los jóvenes y fomenten conversaciones abiertas sobre el uso responsable de la tecnología.

La amenaza de los deepfakes escolares refleja un desafío más amplio: cómo equilibrar las innovaciones en inteligencia artificial con la protección de derechos fundamentales como la privacidad y la dignidad.

Diploma

Los deepfakes escolares se están consolidando como una nueva forma de acoso digital que requiere respuestas coordinadas entre instituciones educativas, familias, desarrolladores tecnológicos y autoridades. La prevención, la educación digital y la regulación serán clave para combatir un fenómeno que, si no se controla, podría aumentar los riesgos en entornos educativos cada vez más digitales.